벡터 공간은 선형대수에서 가장 근본적인 구조다. 이전 포스팅에서 다뤘던 행렬 연산, 역행렬 등이 모두 이 벡터 공간 위에서 동작한다. 핵심 아이디어는 덧셈과 스칼라 곱에 대해 닫혀있는 집합이 벡터 공간이라는 것이다.

벡터

직관적으로는 크기와 방향이 있는 양이고, 형식적으로는 $n \times 1$ 행렬이다.

$$\mathbf{v} = \begin{pmatrix} v_1 \\ v_2 \\ \vdots \\ v_n \end{pmatrix}, \quad v_i \in \mathbb{R}$$

여기서 중요한 건 벡터의 정체성은 위치가 아니라 크기와 방향이라는 점이다. 좌표 평면 위에서 $P(p_1, p_2)$에서 $Q(q_1, q_2)$로 향하는 벡터 $ \vec{PQ}$가 있다고 하자. 이 벡터의 시점을 원점으로 평행이동하면 종점이 $(q_1-p_1, q_2-p_2)$가 되는데, 이 벡터는 $ \vec{PQ}$와 크기 및 방향이 같으므로 같은 벡터다. 즉 벡터는 어디에 놓든 상관없이 크기와 방향만 같으므로 동일하다.

벡터의 연산

덧셈과 뺄셈

같은 차원의 두 벡터는 성분별로(element-wise) 더하거나 뺀다.

$$\vec{u} = \begin{pmatrix} u_1 \\ u_2 \end{pmatrix}, \vec{v} = \begin{pmatrix} v_1 \\ v_2 \end{pmatrix} \Rightarrow \vec{u} \pm \vec{v} = \begin{pmatrix} u_1 \pm v_1 \\ u_2 \pm v_2 \end{pmatrix}$$

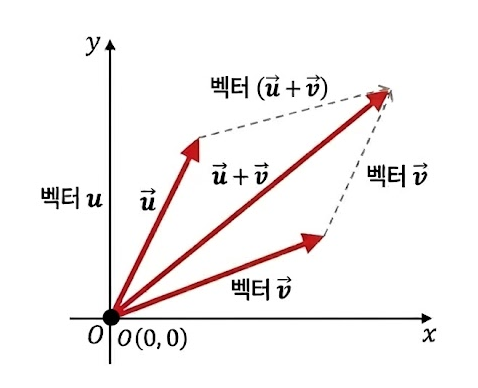

기하학적으로 $\vec{u} + \vec{v}$는 평행사변형 법칙을 따른다. $\vec{u}$의 끝점에서 $\vec{v}$를 이어 붙인 것과 같다. $\vec{u} - \vec{v}$는 $\vec{v}$의 방향을 뒤집은 $-\vec{v}$를 더한 것이다.

스칼라 곱(실수배)

벡터에 실수 $r$을 곱하면 각 성분에 $r$이 곱해진다.

$$r\vec{u} = r \begin{pmatrix} u_1 \\ u_2 \end{pmatrix} = \begin{pmatrix} ru_1 \\ ru_2 \end{pmatrix}$$

$r > 0$이면 방향은 그대로, 크기만 $r$배가 된다. $r <0$이면 방향이 반대로 뒤집힌다.

벡터 공간(Vector Space)

덧셈과 스칼라 곱이 정의된 집합 $V$가 다음 조건을 모두 만족하면 $V$를 벡터 공간이라 한다.

- $a + b = b + a$ (교환 법칙)

- $(a + b) + c = a + (b + c)$ (결합 법칙)

- $u + 0 = 0 + u = u$ (항등원)

- $u + (-1)u = 0$ (역원)

- $k(a + b) = ka + kb$

- $(k + l)a = ka + la$

- $k(lu) = (kl)u$

- $1u = u$

가장 대표적인 벡터 공간이 $ \mathbb{R}^n$이다. 직관적으로 이해하면 벡터 공간이란 벡터끼리 더하거나 실수를 곱해도 그 공간 안에 머무르는 집합이다.

닫혀있다(closed) 의미

가장 처음 언급했던 벡터 공간의 정의에서 닫혀있다 즉 $V$는 $+, \cdot$ 연산에 닫혀있다는 다음을 의미한다.

$$\mathbf{a}, \mathbf{b} \in V \implies \mathbf{a} + \mathbf{b} \in V$$

$$k \in \mathbb{R}, \mathbf{a} \in V \implies k\mathbf{a} \in V$$

즉 $V$ 안의 원소들을 가지고 덧셈이나 스칼라 곱을 해도 결과가 항상 $V$ 안에 있어야 한다. 밖으로 튀어나가면 벡터 공간이 아니다. 예를 들어 $\mathbb{R}^2$의 제 1사분면$(x >0, y>0)$은 덧셈에는 닫혀있지만, $k = 1$을 곱하면 제 3사분면으로 가버리므로 스칼라 곱에 닫혀있지 않다. 따라서 벡터 공간이 아니다.

부분 공간(Subspace)

$V$가 벡터 공간이고, $ W \subseteq V, \quad W \neq \emptyset$일 때 $W$가 덧셈과 스칼라 곱에 대해 닫혀있으면 $W$를 $V$의 부분 공간이라 한다.

$\mathbb{R}^2$를 예로 들면, 원점을 지나는 직선은 $\mathbb{R}^2$의 subspace다. 왜냐하면 그 직선 위의 벡터 두 개를 더하거나 실수를 곱해도 여전치 같은 직선 위에 있기 때문이다. 반면 원점을 지나지 않는 직선은 subspace가 아니다. $0$을 포함하지 않으므로 항등원 조건부터 실패한다.

ML에서 다루는 거의 모든 데이터는 벡터다. 이미지는 픽셀 값의 고차원 벡터, 텍스트는 embedding 벡터, 추천 시스템의 user 및 item representation도 벡터다. 벡터 공간의 성질이 보장되기 때문에 gradient를 더하고 learning rate를 곱하는 등의 최적화 연산이 의미를 가진다. 벡터 공간이라는 구조가 없었다면 $\mathbf{w} \leftarrow \mathbf{w} - \eta \nabla L$ 같은 업데이트가 성립되지 않는다. 거창하게 말했지만 모든 연산이 벡터 공간 위에서 이루어진다는 의미다.

'Mathematics' 카테고리의 다른 글

| [선형대수학#9] Basis & Dimension (0) | 2026.03.15 |

|---|---|

| [선형대수학#8] Span & Linear Independence (0) | 2026.03.14 |

| [선형대수학#6] 가우스 소거법 (Gaussian Elimination) (0) | 2026.03.11 |

| [선형대수학#5] 행렬 변환 (0) | 2026.03.09 |

| [선형대수학#4] 역행렬 (0) | 2026.03.09 |